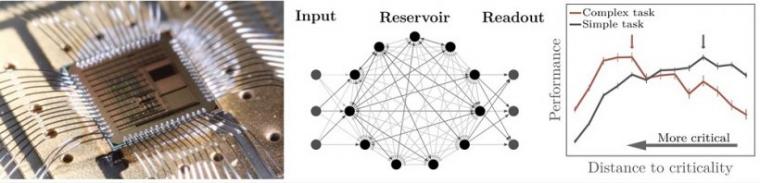

当网络的动态处于“临界点”时,许多计算特性会被最大化。在临界点上,系统可以快速地改变其整体特性的基本方式,例如在有序与混沌或稳定与不稳定之间进行转换。因此,在递归神经网络中,临界状态被广泛地认为是任何计算的最优解人工智能应用.

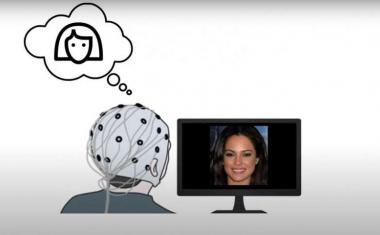

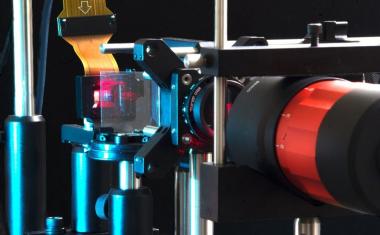

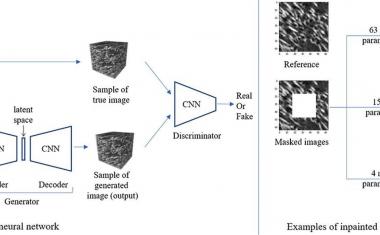

来自HBP合作伙伴海德堡大学和马克斯-普朗克动力学和自组织研究所的研究人员,通过测试一种脉冲循环神经网络在一系列具有不同复杂性的任务上的性能,挑战了这一假设。他们在模拟神经形态脑尺度2系统的原型上实例化了这个网络。BrainScaleS是一种最先进的大脑计算系统,具有直接在芯片上实现的突触可塑性。它是欧洲人脑项目目前正在开发的两个神经形态系统之一。

首先,研究人员发现通过改变输入强度可以很容易地在芯片中调整临界度的距离,然后证明了临界度与任务性能之间的清晰关系。临界状态对每个任务都有好处的假设并没有得到证实:然而信息论的测量都表明,网络容量在临界状态下是最大的,只有复杂的、记忆密集的任务从中受益,而简单的任务实际上受到了影响。因此,该研究提供了一个更精确的理解,集体网络状态应该调整到不同的任务需求,以获得最佳性能。

在力学上,通过调整平均输入强度,可以很容易地在稳态塑性下设定每个任务的最佳工作点。这个机制背后的理论是最近在马克斯·普朗克研究所发展起来的。MPIDS小组组长、资深作者Viola Priesemann说:“将其应用于神经形态硬件表明,这些可塑性规则在调整网络动态以改变临界距离方面非常有能力。”因此,不同复杂性的任务可以在这个空间内得到最佳解决。

这一发现也可以解释为什么生物学神经网络不一定要在临界状态下操作,而是在临界点的动态丰富的附近进行操作,在这里,它们可以根据任务需求调整计算属性。此外,它建立了神经形态硬件作为一个快速和可扩展的途径来探索生物可塑性规则对神经计算和网络动力学的影响。海德堡大学的第一作者本杰明·克拉默(Benjamin Cramer)说:“下一步,我们现在研究并描述峰值网络的工作点对人工和真实世界口语词汇分类的影响。”

研究结果发表在自然通讯.

来源:马普动力学与自组织研究所