由格拉斯哥大学心理和神经科学学院领导的一项新研究使用3 d建模来分析深海神经网络-更广泛的家庭的一部分机器学习-处理信息,可视化它们的信息处理如何与人类相匹配。

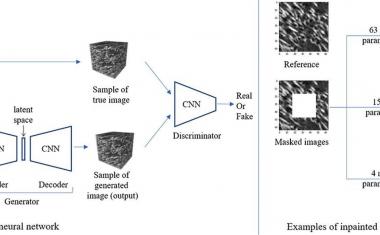

人工智能发展仍面临的挑战之一是,如何更好地理解机器思考的过程,以及它是否符合人类处理信息的方式,以确保准确性。深度神经网络通常被认为是目前人类决策行为的最佳模型,在某些任务中达到甚至超过人类的表现。然而,与人类相比,即使是看似简单的视觉识别任务也能揭示出人工智能模型的明显不一致和错误。

目前,深度神经网络技术被用于人脸识别等应用,虽然它在这些领域非常成功,但科学家仍然不完全了解这些网络如何处理信息,以及何时可能发生错误。

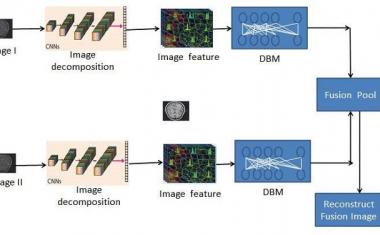

在这项新研究中,研究团队解决了这个问题,通过对深度神经网络提供的视觉刺激建模,以多种方式进行转换,以便通过处理人类和人工智能模型之间的类似信息,展示识别的相似性。

该研究的资深作者、格拉斯哥大学神经科学与技术研究所所长菲利普·施恩斯教授说:“当构建行为“像”人类的人工智能模型时,例如,当他们把一个人的脸视为人类时会识别它,我们必须确保人工智能模型使用的面部信息与另一个人识别它时使用的信息相同。如果人工智能没有做到这一点,我们可能会产生系统像人类一样工作的错觉,但随后发现它在一些新的或未经测试的情况下出错了。”

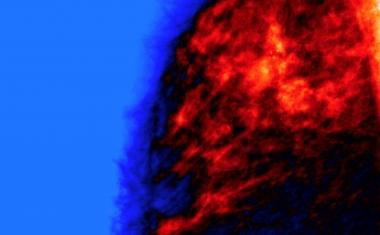

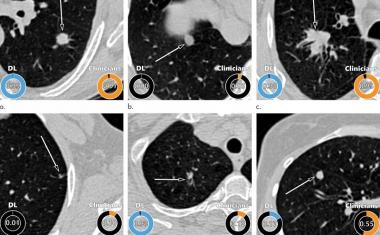

研究人员使用了一系列可修改的3D面孔,并要求人们对这些随机生成的面孔与四个熟悉的身份的相似性进行评级。然后,他们利用这些信息来测试深度神经网络是否出于相同的原因做出了相同的评级——不仅测试人类和人工智能是否做出了相同的决定,还测试了这些决定是否基于相同的信息。重要的是,通过这种方法,研究人员可以将这些结果可视化为驱动人类和网络行为的3D面孔。例如,一个正确分类了2000个身份的网络是由一张严重讽刺的脸驱动的,这表明它识别的人脸处理的面部信息与人类非常不同。

研究人员希望这项工作将为更可靠的人工智能技术铺平道路,使其行为更像人类,减少不可预测的错误。

这项研究发表在杂志上模式.

来源:格拉斯哥大学