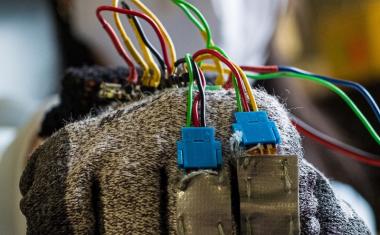

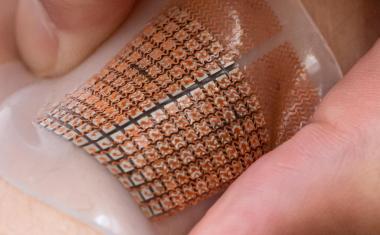

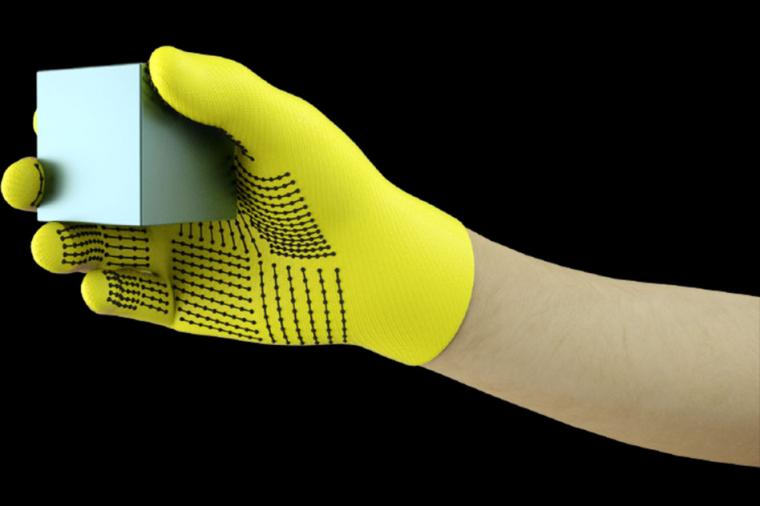

研究人员开发了一种低成本的针织手套,称为“可伸缩触觉手套”(STAG),几乎在整只手上都装有550个微型传感器。当人类以各种方式与物体相互作用时,每个传感器捕捉压力信号。神经网络处理信号,以“学习”与特定对象相关的压力信号模式数据集。然后,该系统使用该数据集对对象进行分类,并通过感觉预测其权重,而无需视觉输入。

研究人员描述了他们使用STAG为26种常见物体编制的数据集,包括汽水罐、剪刀、网球、勺子、钢笔和马克杯。使用该数据集,系统预测对象身份的准确率高达76%。该系统还可以预测大约60克以内大多数物体的正确重量。

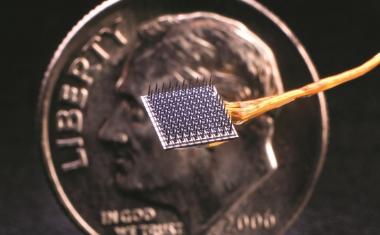

今天使用的类似传感器手套的价格高达数千美元,通常只有大约50个传感器可以捕获较少的信息。尽管STAG能产生非常高分辨率的数据,但它是由商用材料制成的,总价值约为10美元。

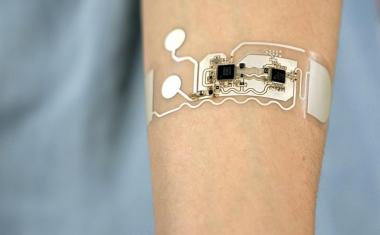

触觉传感系统可以与传统的计算机视觉和基于图像的数据集结合使用,使机器人对与物体的交互有更人性化的理解。计算机科学和人工智能实验室(CSAIL)的前研究生Subramanian Sundaram说:“人类能够很好地识别和处理物体,因为我们有触觉反馈。当我们触摸物体时,我们会感觉周围并意识到它们是什么。机器人没有那么丰富的反馈。”。“我们一直希望机器人能做人类能做的事情,比如洗碗碟或做其他家务。如果你想让机器人做这些事情,它们必须能够很好地操纵物体。”

研究人员还使用该数据集来测量对象交互过程中手部各区域之间的合作情况。例如,当某人使用食指的中关节时,他们很少使用拇指。但是食指和中指的指尖总是与拇指的用法相对应。他说:“我们第一次定量地表明,如果我用手的一部分,我用手的另一部分的可能性有多大。”。

假肢制造商可以潜在地利用信息,比如说,选择放置压力传感器的最佳位置,并根据人们经常接触的任务和对象来定制假肢。

加入Sundaram的有:CSAIL博士后Petr Kellnhofer和Jun Yan Zhu;CSAIL研究生李云珠;Antonio Torralba,EECS教授,麻省理工学院-IBM沃森人工智能实验室主任;和Wojciech Matusik,电子工程和计算机科学副教授兼计算制造小组负责人。

STAG由导电聚合物层压而成,可改变对施加压力的阻力。研究人员将导电线穿过导电聚合物薄膜上的孔,从指尖到手掌底部。螺纹重叠的方式使其成为压力传感器。当戴手套的人触摸、提起、握住和放下物体时,传感器会记录每个点的压力。

这些线从手套连接到一个外部电路,该电路将压力数据转换为“触觉图”,这基本上是一个简单的视频,显示点在手的图形上生长和收缩。点代表压力点的位置,它们的大小代表力-点越大,压力越大。

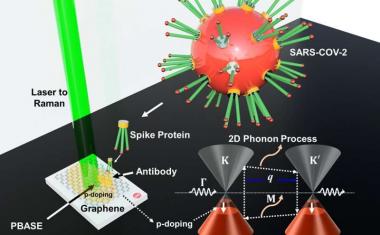

根据这些地图,研究人员汇编了一个数据集,其中包含了来自与26个物体交互的135000个视频帧。这些框架可以被神经网络用来预测物体的身份和重量,并提供关于人类抓握的见解。

为了识别物体,研究人员设计了一种卷积神经网络(CNN),通常用于图像分类,将特定的压力模式与特定的物体相关联。但诀窍是从不同类型的抓取中选择帧来获得物体的完整图像。

这个想法是模仿人类在不使用视力的情况下,以几种不同的方式握住物体来识别它。同样,研究人员的CNN从视频中选择了多达八个半随机帧,代表最不相似的抓握——比如,从底部、顶部和把手握住一个杯子。

但是CNN不能仅仅从每段视频的数千帧中随机选择帧,或者它可能不会选择不同的夹点。相反,它将相似的帧分组在一起,形成与唯一抓取相对应的不同簇。然后,它从每个簇中提取一个帧,确保它具有代表性样本。然后,CNN使用它在训练中学习到的接触模式,从选定的帧预测对象分类。

Kellnhofer说:“我们希望最大化帧之间的变化,为我们的网络提供尽可能好的输入。”。“单个簇内的所有帧都应具有相似的签名,表示抓取对象的相似方式。从多个簇中采样模拟人类在探索对象时以交互方式试图找到不同的抓取方式。”

对于重量估计,研究人员根据手指和拇指拾取、握住和放下物体的触觉图,构建了一个约11600帧的单独数据集。值得注意的是,CNN没有在测试的任何帧上进行训练,这意味着它无法学会仅仅将重量与物体联系起来。在测试中,一个单独的帧被输入到CNN中。本质上,CNN识别出物体重量引起的手周围的压力,并忽略其他因素引起的压力,例如防止物体滑动的手定位。然后根据适当的压力计算重量。

该系统可以与机器人关节上已有的测量扭矩和力的传感器相结合,帮助他们更好地预测物体重量。Sundaram说:“关节对于预测体重很重要,但我们捕获的指尖和手掌也有重要的重量成分。”。

资料来源:麻省理工学院