第一作者兼博士后研究员吉多·范·德·文(Gido van de Ven)和贝勒大学的首席研究员安德烈亚斯·托利亚斯(Andreas Tolias),以及马萨诸塞大学阿姆赫斯特分校的哈瓦·西格尔曼(Hava Siegelmann)写道自然通信他们已经开发了一种新的方法来保护——“惊人地有效”——深海神经网络从“灾难性遗忘”——在学习新课程时,这些网络会忘记他们之前学到的东西。

西格尔曼和他的同事指出,深层神经网络是近期研究的主要驱动力AI.进步,但进展被这一遗忘所抵押。

他们写的是,“一个解决方案是存储先前遇到的例子并在学习新的时重新审视它们。虽然这样的“重播”或“排练”解决了灾难性的遗忘,但“他们补充道”,“他们补充道”,持续地掠夺所有先前学习的任务是高效,并且必须存储的数据量快速变得无法管理。“

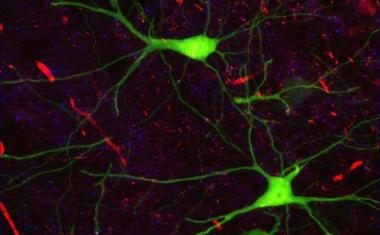

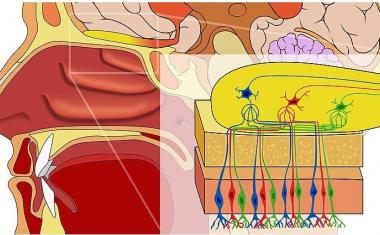

与AI神经网络不同,人类能够在整个生命中持续积累信息,在早期的课程上建立。他们认为,大脑中的一个重要机制是防止忘记的记忆是代表这些记忆的神经元活动模式的重播。

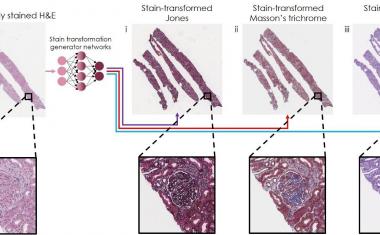

Siegelmann表示,该团队的主要洞察力是“认识到大脑中的重播不存储数据”。相反,“大脑在高度较高的水平下产生记忆的表示,没有必要产生详细的记忆。”灵感来自于此,她和同事创造了一个人为大脑的重播,其中没有存储数据。相反,与大脑一样,网络产生之前所见的高级表示。

“摘要生成大脑重播”证明了极其效率,而该团队表明只需重播一些生成的表示就足以记住较旧的记忆,同时学习新的记忆。生成重播不仅可以防止灾难性忘记并提供一个新的更简化的系统学习路径,它允许系统概括到他们状态的一种情况。

例如,Van de Ven说:“如果我们的具有生殖回放功能的网络首先学会区分猫和狗,然后区分熊和狐狸,它也将能够区分猫和狐狸,而无需同时看到猫和狐狸。”

他和同事写道,“我们提出了一种新的脑卒中的重播变体,其中重放内部或隐藏的表示,由网络自己的上下文调制的反馈连接生成。我们的方法在不存储数据的情况下挑战持续的持续学习基准,实现了最先进的性能,并且它为大脑中的抽象水平重播提供了一种新颖的模型。“

van deve说:“我们的方法对重播可能有助于大脑中的内存整合的方式进行几个有趣的预测。我们已经在运行实验来测试其中一些预测。“

来源:马萨诸塞大学阿默斯特