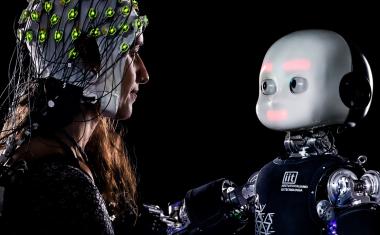

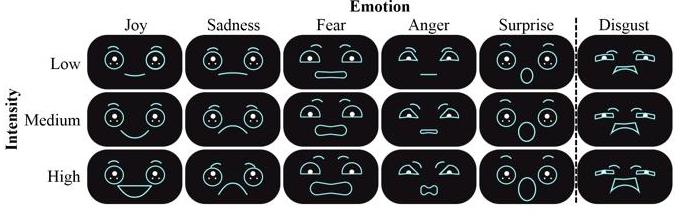

研究人员使用一组在无人机上呈现的机器人面部表情进行了两项研究,这些表情传达了基本的情感。这些面孔使用四个核心面部特征:眼睛、眉毛、瞳孔和嘴巴。结果表明,在静态刺激中,五种不同的情绪(喜悦、悲伤、恐惧、愤怒、惊讶)可以被高精度识别,而在动态视频中,四种情绪(喜悦、惊讶、悲伤、愤怒)可以被高精度识别。厌恶是唯一一种很少被认识的情绪。

“参与者进一步受到无人机的影响,并提出了不同的反应,包括同理心,取决于无人机的情感,”Cauchard教授说。“令人惊讶的是,参与者在无人机的情绪状态周围创造了叙述,并包括在这些场景中。”

BGU研究人员提出了许多建议,这将提高无人机的可接受性,以便在情感支持和其他社会情况下使用。这些包括使用五种基本情绪添加拟人特征,并使用同理反应来推动健康和行为改变应用程序的顺应性。

“BGU是世界上一些最显着的机器人研究,”Ben-Gurion大学美国人首席执行官Doug Seserserman说。“我们预见的继续创新利用人机杂交互动技术,导致采用更大的采用和更有益的应用。”

来源:本古里安大学