我们可以信任愚蠢的机器人吗?

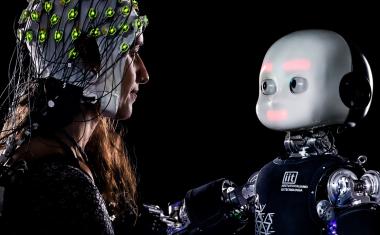

密歇根大学(University of Michigan)的一项研究显示,当机器人犯错时,与人类同事重建信任取决于机器如何承认错误,以及它们看起来有多像人类。

在一项研究中,审查了多个信任修复策略的道歉,否认,解释或承诺 - 研究人员发现,某些针对人类同事的某些方法比其他人更好,并且经常受到如何影响的机器人看。

密歇根大学信息学院副教授莱昂内尔•罗伯特表示:“机器人肯定是一种技术,但它们与人类的互动是社交的,如果我们希望人类能够轻松地信任和依赖机器人同事,我们就必须考虑到这些社交互动。”

“机器人将在与人类合作时犯错误,减少人类对他们的信任。因此,我们必须制定方法来维修人类和机器人之间的信任。具体的信任修复策略比其他人更有效,其有效性可以取决于机器人出现的人。“

在他们的研究中,罗伯特和博士生康纳·埃斯特伍德研究了修复策略——包括一种新的解释策略——如何影响驱动信任的因素:能力(胜任力)、正直(诚实)和仁慈(对委托人的关心)。

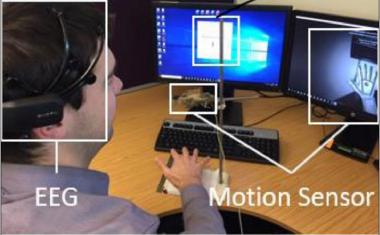

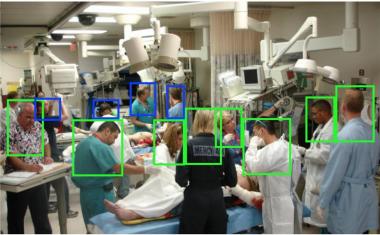

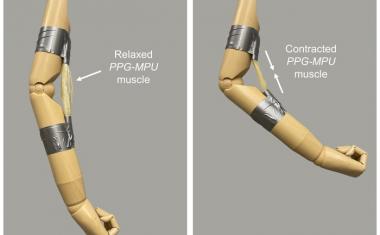

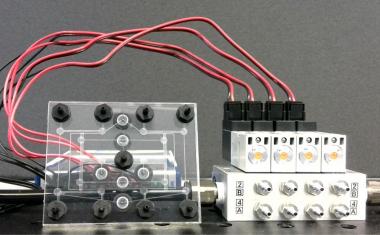

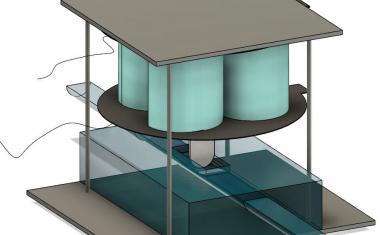

研究人员招募了164名参与者,让他们在虚拟环境中与机器人一起工作,将箱子装到传送带上。这个人是质量保证人员,与机器人一起工作,读取序列号并装载10个特定的箱子。一个机器人拟人偶尔或者更多的人类,其他更具机械的外观。

The robots were programed to intentionally pick up a few wrong boxes and to make one of the following trust repair statements: “I’m sorry I got the wrong box” (apology), “I picked the correct box so something else must have gone wrong” (denial), “I see that was the wrong serial number” (explanation), or “I’ll do better next time and get the right box” (promise).

之前的研究将道歉、否认和承诺视为信任或可信赖的因素,但这次的研究是第一次将解释视为一种修复策略,而且无论机器人的外表如何,解释对其诚信的影响最大。

当机器人变得更像人类时,人们更容易恢复对机器人的信任:当机器人做出解释时,人们更容易恢复对机器人的信任;当机器人做出道歉、否认和解释时,人们更容易恢复对机器人的信任。

与在以前的研究一样,从机器人介绍的诚信和仁慈而不是拒绝。当它来到仁慈和诚信的衡量标准时,应突出道歉和否认。

Esterwood表示,这项研究正在持续提前涉及不同环境中的信托维修的其他组合,与其他违规行为。“在这样做,我们可以进一步扩展这项研究,并在日常生活中审查更现实的情景,”Esterwood说。“例如,Barista机器人的解释是对出错的解释,并且在未来的修复信任中更好地做得更好的承诺,更多或少于建筑机器人?”

这项研究发表于此第30届IEEE国际会议论文集《机器人与人类互动交流》

来源:密歇根大学