虽然我们的面部表情在建立信任方面发挥着巨大的作用,但大多数机器人仍然会摆出一副职业扑克玩家那种空白和静止的表情。随着使用的增加机器人从养老院到仓库和工厂,在机器人和人类需要密切合作的地方,对更灵敏、更逼真的机器人的需求正变得越来越迫切。

哥伦比亚大学工程学院(Columbia Engineering)创意机器实验室(Creative Machines Lab)的研究人员对机器人和人类之间的互动长期感兴趣,他们已经花了五年时间研发EVA,这是一种新型自主机器人,拥有一张柔软而富有表情的脸,可以对附近人类的表情做出回应。

“伊娃的想法成形几年前,当我和我的学生开始注意到我们实验室的机器人是回头凝视我们通过塑料,瞪视的眼睛,“利普森说,詹姆斯和莎莉Scapa教授的创新(机械工程)和创意机器实验室主任。

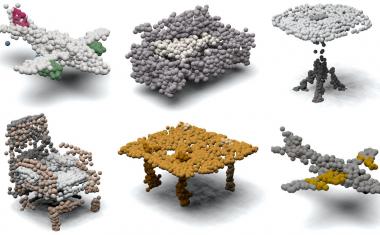

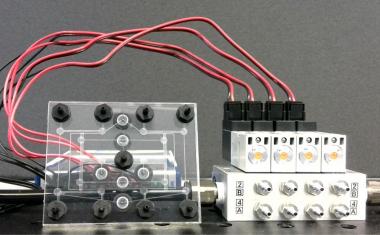

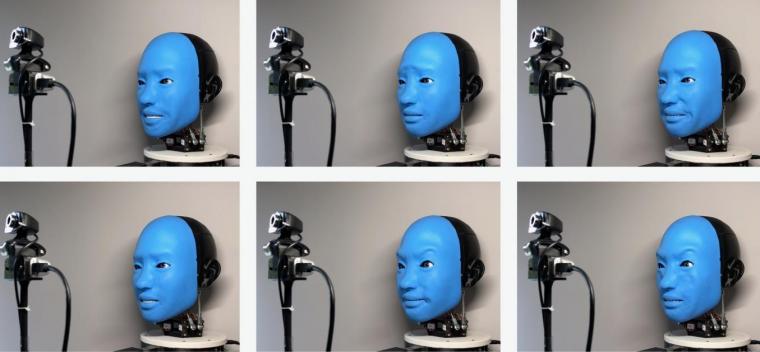

这个项目的第一阶段是几年前在立普生的实验室里开始的,当时本科生赞瓦尔·法拉吉带领一个学生团队建造了这个机器人的物理“机器”。他们把EVA建造成一个无实体的半身像,与蓝人乐队(Blue Man Group)那些沉默但面部表情活跃的表演者极为相似。EVA可以表达愤怒、厌恶、恐惧、喜悦、悲伤和惊讶这六种基本情绪,以及一系列更微妙的情绪,通过使用人造“肌肉”(即电缆和马达)拉动EVA脸上的特定点,这是为了模仿附在人体面部皮肤和骨骼不同部位的超过42块微型肌肉的运动。

Faraj指出:“创造EVA的最大挑战是设计一个足够紧凑的系统,以适应人类头骨的范围,同时还能产生各种各样的面部表情。”

为了克服这一挑战,该团队严重依赖3D打印来制造具有复杂形状的零件,这些零件与EVA的头骨无缝且高效地集成在一起新利18官方。经过数周的拉电缆使EVA微笑、皱眉或看起来沮丧,研究小组注意到EVA的蓝色、无实体的脸可以引起他们实验室同伴的情绪反应。“有一天我正忙着自己的事,EVA突然给了我一个大大的、友好的微笑,”立普生回忆说。“我知道这纯粹是机械的,但我发现自己也本能地报以微笑。”

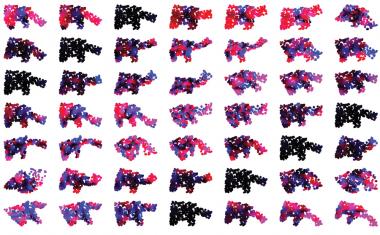

一旦团队对EVA的“机制”感到满意,他们就开始着手该项目的第二个主要阶段:为引导EVA面部动作的人工智能编程。虽然栩栩如生的电子机器人已经在主题公园和电影制片厂使用了多年,但利普森的团队在两项技术上取得了进展。EVA使用深度学习人工智能“阅读”,然后反射附近人类的表情。EVA模仿各种不同人类面部表情的能力是通过观看自身视频的反复试验来学习的。

最难实现自动化的人类活动包括发生在复杂社会环境中的非重复性身体动作。领导该项目软件阶段的立普生博士研究生陈博元(音)很快意识到EVA的面部运动是一个过于复杂的过程,无法用预定义的规则来控制。为了解决这一挑战,陈和另一组学生用几颗卫星创造了EVA的大脑深度学习神经网络.机器人的大脑需要掌握两种能力:第一,学会使用自己复杂的机械肌肉系统来产生任何特定的面部表情;第二,通过“阅读”人类的面部表情来知道该做出什么样的表情。

为了让EVA知道它自己的脸是什么样的,陈和他的团队拍摄了数小时EVA随机做出一系列面部表情的镜头。然后,就像一个人在Zoom上看着自己一样,EVA的内部神经网络学会了将肌肉运动与自己的脸部视频片段配对。现在EVA对它自己的脸是如何工作的有了一个原始的感觉(称为“自我形象”),它使用第二个网络来匹配它自己的自我形象和它的摄像机捕捉到的人脸图像。经过几次改进和迭代,EVA获得了从相机读取人类面部手势的能力,并通过镜像人类的面部表情做出反应。

研究人员指出,EVA是一项实验室实验,仅靠模仿与人类通过面部表情进行交流的复杂方式还相距甚远。但这样的技术有一天可能会在现实世界中得到有益的应用。例如,能够对各种各样的人类肢体语言做出反应的机器人将在工作场所、医院、学校和家庭中发挥作用。

利普森说:“人类与基于云的聊天机器人或无实体智能家居扬声器的情感互动是有限的。”“我们的大脑似乎对具有某种可识别的物理存在的机器人反应良好。”

陈补充说,“机器人在我们的生活中越来越多地交织在一起,所以在人和机器之间建立信任变得越来越重要。”

来源:哥伦比亚大学