人工智能系统越来越被称为深度学习神经网络用于告知对人类健康和安全至关重要的决策,如医疗诊断。这些网络擅长识别大型复杂数据集中的模式,以帮助决策。但是我们怎么知道他们是正确的呢?亚历山大·阿米尼和他在麻省理工学院和哈佛大学的同事们想找到答案。

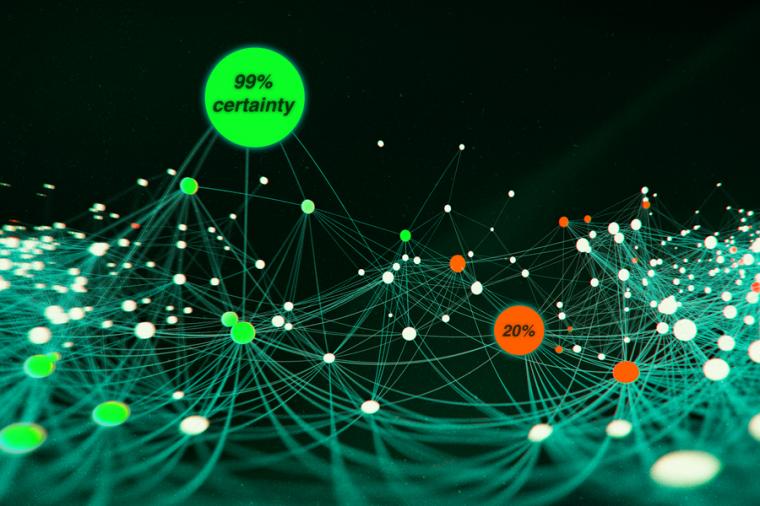

他们开发了一种神经网络快速处理数据的方法,不仅输出预测,还输出基于可用数据质量的模型置信度。这一进展可能会挽救生命,正如深度学习现在已经在现实世界中部署了。网络的确定性水平可能是自动驾驶车辆确定“通过交叉口时一切安全”和“可能安全,所以停车以防万一”之间的差异

目前的神经网络不确定性估计方法往往计算量大,对于分秒决策而言速度相对较慢。但阿米尼的方法被称为“深层证据回归”,加快了这一过程,并可能导致更安全的结果。麻省理工学院计算机科学与人工智能实验室(CSAIL)Daniela Rus教授团队的博士生阿米尼说:“我们不仅需要拥有高性能模型的能力,还需要理解我们何时不能信任这些模型。”。

Rus说:“这个想法很重要,而且适用范围很广。它可以用来评估依赖学习模型的产品。通过估计学习模型的不确定性,我们还可以了解模型的预期误差,以及哪些缺失的数据可以改进模型。”。

有效不确定性

在经历了一段起伏不定的历史之后,深度学习在各种任务上表现出了卓越的表现,在某些情况下甚至超过了人类的准确性。如今,深度学习似乎无处不在。它为搜索引擎结果、社交媒体订阅源和面部识别.阿米尼说:“我们在深度学习方面取得了巨大的成功。“神经网络确实擅长在99%的时间里知道正确答案。”但99%的人在生命危在旦夕的时候不会这么做。阿米尼说:“有一件事一直困扰着研究人员,那就是这些模型是否有能力知道并告诉我们它们何时可能出错。”“我们真正关心的是那1%的时间,以及我们如何可靠和有效地检测这些情况。”

神经网络可能是巨大的,有时充满了数十亿个参数。因此,仅仅为了得到一个答案就可能需要大量的计算,更不用说信心水平了。神经网络中的不确定性分析并不新鲜。但是以前的方法,源于贝叶斯深度学习,多次依赖于运行或采样神经网络来了解其可信度。这一过程需要时间和内存,这在高速交通中可能不存在。

研究人员设计了一种仅通过一次神经网络运行来估计不确定性的方法。他们设计了一个具有大量输出的网络,不仅产生了一个决策,而且还产生了一个新的概率分布,以捕获支持该决策的证据。这些分布,称为证据分布,直接捕获模型对其预测的置信度。这包括基础输入数据以及模型最终决策中存在的任何不确定性。这种区别可以表明是否可以通过调整神经网络本身来减少不确定性,或者输入数据是否只是噪声。

信心检查

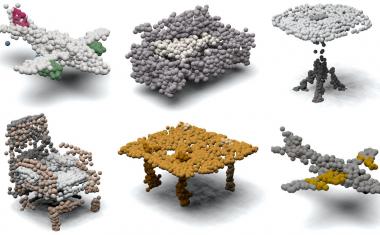

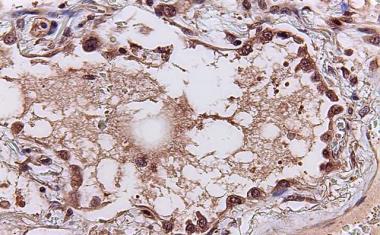

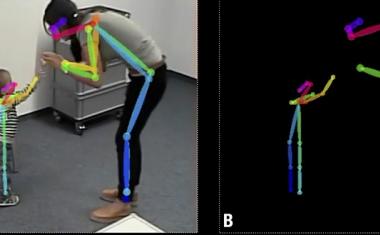

为了测试他们的方法,研究人员从一个具有挑战性的实验开始计算机视觉任务他们训练神经网络来分析单眼彩色图像,并估计每个像素的深度值(即距相机镜头的距离)。自动驾驶车辆可能会使用类似的计算来估计其与行人或其他车辆的距离,这不是一项简单的任务。

他们的网络性能与之前最先进的模型不相上下,但它也获得了估计自身不确定性的能力。正如研究人员所希望的那样,在预测错误深度的地方,网络对像素的预测具有很高的不确定性。阿米尼说:“它非常精确地校准了网络产生的误差,我们认为这是判断一个新的不确定性估计器质量的最重要的事情之一。”

为了对他们的校准进行压力测试,该团队还表明,该网络对“非分布”数据的不确定性更高——这是训练中从未遇到的全新类型的图像。在对网络进行室内家庭场景训练后,他们向网络输入了一批户外驾驶场景。该电视台一直警告说,它对新奇的户外场景的反应是不确定的。该测试强调了网络在用户不应该完全信任其决定的情况下做出标记的能力。阿米尼说,在这些情况下,“如果这是一个医疗应用程序,也许我们不相信模型给出的诊断,而是寻求第二种意见。”

“使用[神经网络]方法的任何用户,无论是医生还是车辆乘客,都需要意识到与该决定相关的任何风险或不确定性。”

该网络甚至知道照片何时被篡改,这有可能避免数据操纵攻击。在另一项试验中,研究人员提高了他们提供给网络的一批图像中的对抗性噪声水平。这种影响很微妙——人眼几乎无法察觉——但网络嗅出了这些图像,并将其输出标记为高度不确定性。这种对伪造数据发出警报的能力有助于检测和阻止对抗性攻击,这在伪造时代是一个越来越令人担忧的问题。

深度证据回归是“推进不确定性估计领域的一种简单而优雅的方法,这对于机器人技术和其他现实世界的控制系统非常重要,”一位名叫Raia Hadsell的专家说人工智能DeepMind的研究员,他没有参与这项工作。“这是以一种新颖的方式完成的,避免了其他方法(例如采样或集成)的一些混乱方面,这不仅使其优雅,而且在计算上更高效,这是一个成功的组合。”

深度证据回归可以提高人工智能辅助决策的安全性。阿米尼说:“我们开始看到更多的这些(神经网络)模型从研究实验室流入现实世界,进入那些可能威胁人类生命的情况。”。“该方法的任何使用者,无论是医生还是坐在汽车乘客座椅上的人,都需要意识到与该决定相关的任何风险或不确定性。”他设想该系统不仅能快速标记不确定性,但也可以使用它在危险情况下做出更保守的决策,如自动驾驶车辆接近十字路口。

“任何将要部署机器学习的领域最终都需要有可靠的不确定性意识,”他说。

来源:麻省理工学院