图片首次上任陌生的超市。如果你是一个可以看到的人,你可以简单地环顾四周来引导自己并识别对象和障碍物。然而,盲人必须使用其他感官来通过新的空间找到他们的方式。

很快,盲人可能有一些导航帮助,感谢CALTECH研究人员,他们组合了增强现实硬件和计算机视觉算法来开发使对象能够“谈话”的软件。穿着作为便携式耳机,该技术将光学世界转化为普通的英语音频。该设备可以在银行,杂货店,博物馆和其他地点提供一天,以帮助盲人通过陌生的空间来实现往来的空间。“想象一下,你在一个世界上的所有物体都有声音并且可以与你说话的世界里,”卡特科神经生物科学教授和神经生物学的执行官教授Markus Meister说。“无论您指向凝视,您关注的不同对象都会激活并将其名称发给您。你能想象在这样的世界中,执行我们通常使用视觉系统的许多任务吗?这就是我们在这里做了什么 - 给予对象的声音。“

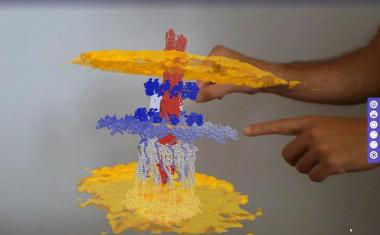

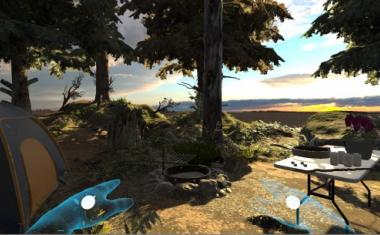

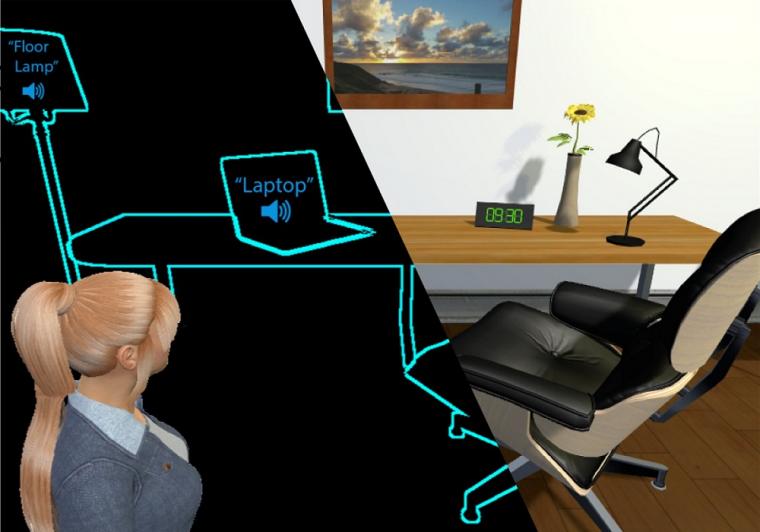

在研究生刘阳的带领下,科学家团队开发了一种名为CARA的系统,即认知增强现实助手。CARA是为一种名为HoloLens的可穿戴头戴式计算机开发的,该计算机由微软公司开发,可以扫描用户的环境,并识别单个物体,如笔记本电脑或桌子。使用CARA,环境中的每个对象都有一个声音,并根据用户的命令“说出”它的名字。这项技术利用了所谓的空间化声音,它会使物体在房间内的位置不同,发出不同的声音。例如,如果对象在用户的左边很远的地方,那么它的声音听起来就像是从左边来的。此外,物体越靠近,其“声音”的音调就越高。

各种模式

为了避免物体同时说话时产生的杂音,刘和他的团队为CARA设计了几种不同的模式。在第一种模式中,当用户直接面对对象时,对象才会说出它的名字。当用户转头面对不同的物体时,每个物体都会说出它们的名字,而物体声音的音高提供了一个听觉线索,表明它与用户的相对距离。通过这种方式,视力受损的用户可以“环顾四周”来探索他们的环境。在第二种模式中,称为扫描模式,环境从左到右扫描,物体相应地说出它们的名字。第三种模式是目标模式,用户可以选择一个对象进行单独的对话,并将其作为导航指南。

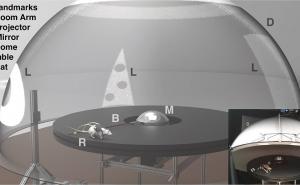

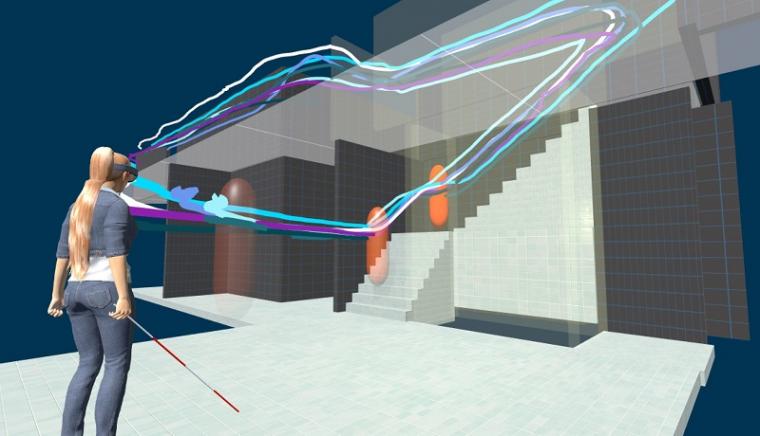

为了测试Cara的实际应用,研究人员设计了通过Caltech的Beckman行为生物学建设的盲人志愿者的测试路线。为了准备任务,科学家首先通过建筑物开发了一条路线,然后佩戴挖掘机的途径,扫描环境并将其保存到记忆中。然后,要求盲人志愿者使用Cara作为指导导航路线。当每个志愿者开始时,一个声音,看似从路线前面的位置发出,呼吁“跟随我”,同时还告诉用户楼梯,手轨,角落转弯等等。由Cara领导,所有七个志愿者在第一次尝试时成功完成了任务。

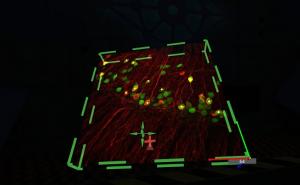

Cara仍处于早期阶段,但将受益于计算机视觉算法的快速发展。研究人员已经实施了新计划,用于实时识别物体和行人。最终,他们希望银行,酒店和购物中心等地将提供Cara设备,供他们的盲人客户使用。

来源:加州理工学院