大学:赫尔辛基大学

对类人机器人的态度更加消极

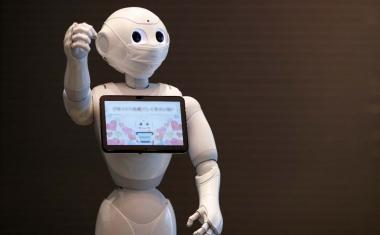

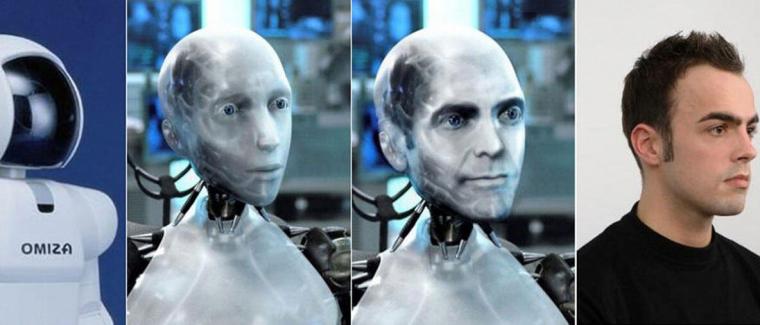

根据这项研究,人们较少考虑类人机器人iRobot和iClooney所做的选择在伦理上听起来比人类和具有传统机器人外观的机器人做出的相同决定还要好。Michael Laakasuo,项目负责人和这项研究的首席研究员,将这些发现与恐怖谷效应联系在一起,这在之前的研究中已经被确认。

“人工智能中的人性被认为是怪异或令人毛骨悚然的,人们对这种机器人的态度比对更像机器的机器人的态度更消极。这可能是由于,例如,难以对类人生物做出反应:它是动物、人还是工具?”

Laakasuo表示,研究结果表明,人类并不认为机器人做出道德决定是一种奇怪的想法,因为人类和传统机器人做出的决定被视为同样可以接受。相反,机器人的外观会对评估他们的道德产生影响。

讨论指导人工智能的调控

拉卡索表示,在我们的社会中,做出道德选择的智能机器的数量正在增长,自动驾驶汽车就是一个例子。“了解人们如何看待智能机器,以及哪些因素会影响相关的道德评估,这很重要。例如,一辆时尚的自动驾驶汽车违反交通规则的行为与那些不那么经典的车型会有不同的感知吗?”

这些知识可以影响人工智能和机器人的发展方向,以及产品品牌。知识也可以影响有关人工智能监管的政治讨论。例如,自动驾驶汽车可以成为私营公司的各种测试实验室:在发生事故的情况下,可以用钱来处理后果,以技术进步的名义,诉诸结果主义道德,冒着人类健康的风险。

“我们希望拥有什么样的机器人:在被电车碾过的情况下拯救5个人,牺牲1个人,或者拒绝牺牲任何人,即使这意味着挽救几条生命?”如果机器人的外观会影响人们对其行为的道德感,那么它们是否应该被设计得像人类?”

来源:赫尔辛基大学